Mardi 10 mars 2026, le Campus de NEOMA à Paris accueillait la seconde édition de notre rendez-vous dédié à l’intelligence artificielle dans l’enseignement supérieur et la recherche. Des dizaines de professionnels du secteur ont répondu présent. Dirigeants d’établissements, responsables de la transformation numérique, experts de la gouvernance des données, représentants institutionnels : la salle reflétait la diversité et l’exigence du secteur.

L’ambition de l’événement est simple. Partager les regards et les pratiques. Ce qui fonctionne, ce qui résiste, ce qui reste à construire. Permettre à tout l’écosystème de progresser, ensemble.

Une ligne éditoriale, des voix multiples

La journée s’est ouverte avec Delphine Manceau, Directrice Générale de NEOMA et Présidente de la Conférence des Grandes Écoles. Son introduction a posé le cadre avec clarté : l’IA n’est plus un horizon à préparer. Elle est dans la salle. La question est désormais celle de la transformation collective.

Aurélien Fénard, Directeur de la Transformation Digitale et des données RH à France Travail, a pris le relais pour la keynote d’ouverture. Son regard croisé, entre monde de l’emploi et enjeux de formation, a donné une perspective précieuse sur la réalité concrète du « glissement des compétences » en cours.

Le premier panel a réuni trois voix complémentaires. Xavier Caillard, Directeur adjoint à la Transformation et aux Services de Mines Paris PSL, a partagé une approche pragmatique de la souveraineté numérique. Léna Touchard, co-fondatrice de STEM Academy & Women in STEM, a mis en lumière les enjeux de diversité et d’inclusion dans un secteur technologique qui reste inégalitaire. Olivier Wong, VP Numérique à l’Université de Rennes, a apporté le regard d’un acteur engagé dans la transformation organisationnelle d’une grande université publique.

La pause a permis à tous les participants de découvrir les projets IA de NEOMA de manière concrète : avatars pédagogiques, IA intégrée aux services, dispositifs de formation. Une démonstration par l’exemple, cohérente avec l’esprit de l’événement.

La seconde partie : gouvernance, souveraineté et stratégie

Aurélie Simard, Directrice Générale du Centre d’Expertise pour la coopération internationale en IA au GPAI / INRIA, a livré une analyse rigoureuse et engagée sur la concentration du pouvoir technologique mondial. Un éclairage géopolitique rare, et nécessaire.

Le dernier panel a réuni trois experts de la conduite du changement. Fatima Aïd-Saïd, Inspectrice Générale de l’ESR au Pôle Data, IA et Numérique, a apporté la perspective institutionnelle de l’État. Marine Le Fichant, Senior Manager Data & IA chez MC2i, a traduit les enjeux en leviers opérationnels concrets. Mattias Mano, Directeur du Centre d’Innovation pédagogique de l’Université PSL, a partagé une expérience de terrain précieuse sur l’accompagnement des équipes enseignantes.

J’ai eu le plaisir de conclure cette demi-journée en partageant deux convictions fortes sur l’avenir de l’IA dans l’enseignement supérieur.

Cet article en restitue les moments clés. Il partage également la charte IA de NEOMA, rendue publique à cette occasion et mes deux convictions pour le secteur.

L’IA n’est plus dans le couloir. Elle est dans la salle.

L’honnêteté s’impose d’emblée. Ce n’est plus une question d’anticipation. L’IA générative est déjà présente dans les amphithéâtres, les bureaux administratifs et les salles de réunion des équipes pédagogiques. La vraie question n’est pas de savoir s’il faut l’intégrer. Elle est de savoir comment transformer nos établissements intelligemment.

C’est ce qu’a posé avec clarté Delphine Manceau dès l’ouverture. Le ton était donné. Pas de catastrophisme. Pas de naïveté non plus. Une lucidité construite.

Nous vivons un moment Manhattan (Aurélien Fénard)

Aurélien Fénard a prolongé ce cadrage avec une image forte : nous vivons un « moment Manhattan ». Celui d’une rupture irréversible, dont les effets se mesurent encore mal. La comparaison est saisissante. Elle est aussi utile. Elle oblige à penser en termes de responsabilité collective, pas seulement d’opportunité individuelle.

Ce que cela change pour les institutions

L’IA ne demande pas simplement à être ajoutée aux outils existants. Elle interroge le modèle même de transmission du savoir. Former des étudiants à restituer des connaissances, dans un monde où une IA les produit en quelques secondes, relève d’une logique dépassée. Ce n’est pas agréable à entendre. C’est pourtant nécessaire.

Les institutions qui résistent à cette réalité ne la ralentiront pas. Elles se mettront simplement en retard.

La vraie transformation, c’est le passage d’un modèle centré sur la transmission à un modèle centré sur le jugement. Apprendre à penser, à douter, à arbitrer. L’IA peut produire une réponse. Elle ne peut pas, pour l’instant, en assumer la responsabilité.

IA de substitution ou IA d’augmentation : le choix qui définit tout

C’est l’un des points les plus structurants de la journée. Et l’un des plus concrets.

Aurélien Fénard a posé une distinction essentielle. D’un côté, une IA de substitution : elle fait à la place de l’humain. Elle est rapide, efficace, et atrophie les compétences. « Use it or lose it », comme on dit. De l’autre, une IA de confrontation : elle challenge, questionne, oblige à justifier. Elle augmente l’autonomie.

Le constat est brutal. La majorité des usages actuels relèvent de la substitution.

Pourquoi cette distinction change les pratiques pédagogiques

Ce n’est pas un débat philosophique. C’est une question opérationnelle. Un étudiant qui demande à une IA de rédiger son analyse à sa place n’apprend pas à analyser. Il apprend à valider, parfois sans discernement. Ce n’est pas la même chose.

L’IA comme « sparring partner » est une tout autre posture. On lui soumet une idée. Elle la conteste. On défend. On affine. Le résultat est meilleur, et la compétence est renforcée.

Ce modèle implique une révision profonde des pratiques d’évaluation. C’est là que le consensus de la journée a été le plus net.

Ce que ça implique concrètement pour l’évaluation

Les QCM et les dissertations classiques sont fragilisés. Pas nécessairement supprimés, mais remis en cause dans leur capacité à mesurer ce qui compte vraiment. Plusieurs intervenants l’ont formulé directement : l’enjeu n’est plus d’empêcher la triche. Il est de redéfinir ce qu’on évalue.

Évaluer le processus, pas seulement le résultat. Vérifier la capacité à justifier un raisonnement, pas à le produire mécaniquement. Introduire des formats oraux, des projets documentés, des analyses de cas avec trace de réflexion. Ce n’est pas une révolution pédagogique abstraite. C’est une adaptation urgente.

Souveraineté numérique : l’Europe cherche sa voie

Aurélie Simard a abordé un sujet qui dérange, utilement. Le système socio-technique de l’IA est aujourd’hui extrêmement concentré. Quelques acteurs américains et chinois dominent l’infrastructure, les modèles et les données. L’Europe régule. C’est nécessaire. Ce n’est pas suffisant. L’AI Act est une réponse réglementaire sérieuse. Mais réguler n’est pas maîtriser.

La question qui dérange

Que se passe-t-il quand les données sensibles d’un établissement transitent par des serveurs dont nous ne contrôlons ni la localisation, ni les modalités d’utilisation ? La question n’est pas théorique. Elle est quotidienne.

Xavier Caillard et Olivier Wong ont formulé une position raisonnable et pragmatique : il ne s’agit pas toujours d’utiliser l’outil le plus puissant. Il s’agit d’utiliser l’outil suffisant pour l’usage visé, en maîtrisant les conditions d’hébergement. Pour les données sensibles, les formations critiques, les processus d’évaluation, cette exigence s’impose.

Des alternatives existent. Mistral, des infrastructures souveraines, des projets comme ILAS. Ils nécessitent des investissements, de la coopération et une volonté politique que le secteur commence, progressivement, à structurer.

Gouvernance et accompagnement : les conditions réelles du succès

Le dernier panel a ramené la réflexion à l’essentiel opérationnel. Une stratégie IA sans gouvernance des données ne tient pas. Une transformation technologique sans accompagnement humain échoue. Ce ne sont pas des vérités nouvelles. Elles restent, pourtant, systématiquement sous-estimées.

Fatima Aïd-Saïd l’a formulé clairement : il y a un décalage réel entre la vitesse de la transformation technologique et le temps propre aux organisations et à l’éducation. Ce décalage n’est pas une excuse. C’est un problème à résoudre.

Comment réduire ce décalage

Marine Le Fichant et Mattias Mano ont convergé sur plusieurs leviers concrets. D’abord, partir des « irritants » réels des équipes. Pas des usages imaginés par la direction, mais des problèmes vécus au quotidien par les enseignants, les équipes administratives, les étudiants. Ensuite, co-construire les solutions. Impliquer les utilisateurs finaux dès la conception, pas au moment du déploiement.

Enfin, démystifier. L’IA inquiète souvent ceux qui ne l’utilisent pas encore. La formation, la transparence sur les limites et les risques, la valorisation des expérimentations réussies : ces éléments réduisent les résistances bien plus efficacement que les injonctions.

La gouvernance des données est, dans ce cadre, un prérequis. Pas un sujet technique réservé aux DSI. Un enjeu stratégique, qui conditionne la fiabilité et la légitimité de tout usage de l’IA dans l’institution.

La charte IA de NEOMA : rendre publique une position claire et partagée sur l’IA

À l’occasion de cet événement, NEOMA a rendu publique sa charte IA. Ce document, issu des travaux de l’UNESCO et de la charte de l’Université d’Orléans et des réflexions de l’Université de Franche-Comté, traduit une position institutionnelle claire sur les usages autorisés, encouragés et encadrés de l’IA au sein de l’école, pour les étudiants comme pour les équipes.

Rendre une charte publique, c’est assumer une responsabilité. C’est aussi inviter au dialogue. D’autres établissements traversent les mêmes questionnements. Partager nos choix, nos arbitrages, nos limites : c’est la logique qui a présidé à cet événement dès l’an dernier et que nous conserverons dans toutes les éditions.

Accédez à la charte IA de NEOMA pour découvrir les principes qui s’appliquent, sans distinction à nos étudiants, nos professeurs et nos équipes administratives :

Deux convictions fortes pour conclure

En guise de conclusion, j’ai partagé deux convictions construites au fil de ces échanges et de notre propre expérience à NEOMA.

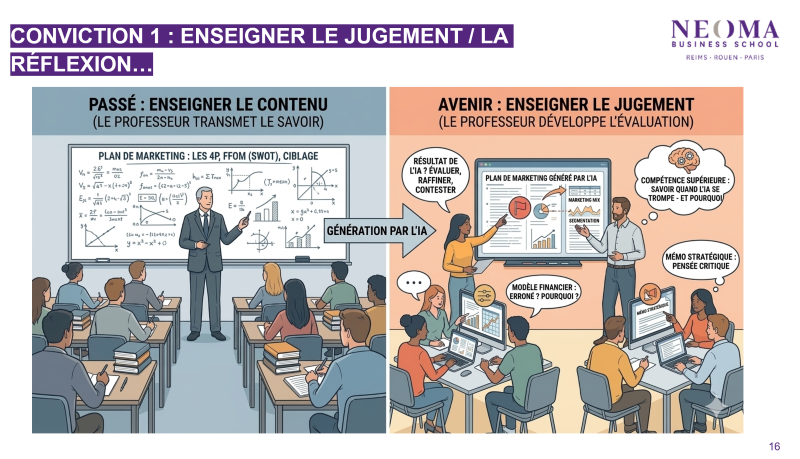

Conviction 1 : enseigner le jugement, pas le contenu

Le modèle pédagogique dominant repose sur une logique de transmission. Le professeur détient le savoir. Il le dépose. L’étudiant le restitue. Ce modèle a une vertu : sa clarté. Il a un défaut majeur aujourd’hui : l’IA le rend obsolète.

Quand une IA génère en quelques secondes un plan marketing complet, une analyse financière ou une synthèse documentaire, que reste-t-il à enseigner ? Tout. Mais pas la même chose.

Ce qui reste à enseigner, c’est le jugement.

Le professeur de demain ne transmet plus un savoir que l’IA produit plus vite que lui. Il développe une capacité d’évaluation. Il apprend à ses étudiants à interroger le résultat de l’IA : est-il juste ? Complet ? Biaisé ? Applicable ? La compétence supérieure n’est plus de produire une analyse. C’est de savoir quand l’IA se trompe, et pourquoi.

Ce renversement est profond. Il n’invalide pas l’expertise disciplinaire. Il la repositionne. L’étudiant travaille avec l’IA, pas à sa place. Il évalue, raffine, conteste. Il développe une pensée critique adossée à l’outil, et non anesthésiée par lui.

C’est ce glissement, du contenu au jugement, que les établissements doivent opérer en priorité.

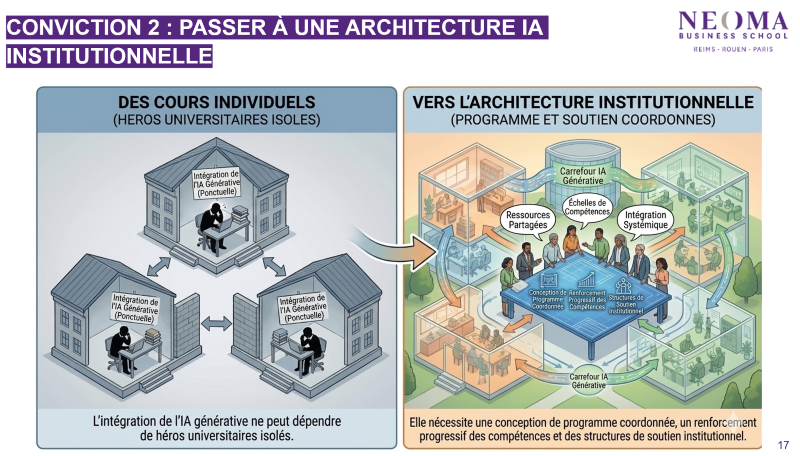

Conviction 2 : passer à une architecture IA institutionnelle

La seconde conviction prolonge la première. Elle porte sur la structure, pas sur la pédagogie seule.

Aujourd’hui, l’intégration de l’IA générative dans l’enseignement supérieur repose majoritairement sur des initiatives individuelles. Des enseignants pionniers, motivés, qui expérimentent dans leur cours, de manière ponctuelle et isolée. Ces héros universitaires font un travail précieux. Ils ne peuvent pas, seuls, faire bouger l’institution.

L’intégration de l’IA générative ne peut pas dépendre de héros isolés.

Ce dont le secteur a besoin, c’est d’une architecture institutionnelle. Une conception de programme coordonnée, qui intègre l’IA de manière cohérente à travers les disciplines et les niveaux. Un renforcement progressif des compétences, pour les étudiants comme pour les équipes enseignantes. Des structures de soutien institutionnel : ressources partagées, échelles de compétences formalisées, carrefours IA accessibles à tous.

Le passage de l’initiative individuelle à l’intégration systémique est la condition du changement durable. Une école qui s’appuie sur trois enseignants convaincus reste fragile. Une école qui a construit une architecture commune est transformée.

C’est à ce chantier que NEOMA s’est attelée. Et c’est, collectivement, le chantier de tout le secteur.

FAQ – Intelligence artificielle et enseignement supérieur

Qu’est-ce que la transformation numérique des établissements d’enseignement supérieur par l’IA implique concrètement ? Elle implique de repenser les méthodes d’évaluation, de former les équipes à un usage critique des outils, de structurer une gouvernance des données et de co-construire les usages avec les parties prenantes, enseignants comme étudiants.

Quelle est la différence entre une IA de substitution et une IA d’augmentation dans l’éducation ? Une IA de substitution exécute une tâche à la place de l’apprenant, réduisant ainsi son autonomie et ses compétences. Une IA d’augmentation, ou IA de confrontation, sert de « sparring partner » : elle challenge le raisonnement, renforce le jugement critique et développe les compétences.

Comment les établissements d’enseignement supérieur peuvent-ils garantir la souveraineté de leurs données face aux outils IA ? En privilégiant des outils hébergés sur des infrastructures européennes ou maîtrisées, en mettant en place une gouvernance claire des données sensibles et en évaluant systématiquement les risques avant tout déploiement.

Pourquoi les méthodes d’évaluation traditionnelles sont-elles remises en question par l’IA générative ? Parce que l’IA peut produire à la demande les résultats attendus par les formats classiques (dissertations, QCM). L’évaluation doit désormais porter sur le processus de réflexion, la capacité à justifier un raisonnement et l’esprit critique, pas seulement sur la restitution d’un contenu.

Qu’est-ce qu’une charte IA dans un établissement d’enseignement supérieur ? Une charte IA formalise la position institutionnelle sur les usages de l’IA : ce qui est autorisé, encouragé ou encadré, pour les étudiants comme pour les personnels. Elle est un outil de gouvernance, de transparence et de dialogue avec l’ensemble de la communauté.

Comment conduire le changement lié à l’IA dans une institution académique ? En partant des besoins réels des équipes, en impliquant les utilisateurs dans la co-construction des solutions, en formant de manière continue et en valorisant les expérimentations. L’accompagnement humain prime sur le déploiement technologique.