La semaine 12 de 2026 restera marquée par une accélération sans précédent. Entre la conférence GTC de NVIDIA, les offensives stratégiques de Mistral AI (avec trois annonces fortes cette semaine) et les controverses autour de l’IA militaire, les décideurs font face à un environnement en mutation rapide. Tour d’horizon complet des annonces qui comptent, et de ce qu’elles impliquent concrètement pour l’entreprise.

NVIDIA vise 1 000 milliards de dollars de revenus d’ici 2027

Lors de la conférence GTC à San José, le PDG de NVIDIA a annoncé que les revenus issus des puces IA pourraient atteindre 1 000 milliards de dollars d’ici 2027. C’est le double de la projection de 500 milliards formulée pour 2026. Un signal fort. La demande en infrastructures IA accélère plus vite que prévu.

L’entreprise a dévoilé ses nouvelles puces Vera Rubin, conçues pour la phase de « prefill » des requêtes IA. Elle a aussi présenté un processeur de nouvelle génération baptisé Feynman. Ces innovations s’appuient sur la technologie de Groq, acquise sous licence pour 17 milliards de dollars en décembre dernier.

Ce que cela change pour les décideurs IA en entreprise

La capitalisation de NVIDIA dépasse désormais 4 300 milliards de dollars. Son écosystème logiciel CUDA reste un avantage concurrentiel majeur, même quand des clients comme Meta développent leurs propres processeurs.

Le basculement du marché est clair. Les entreprises qui ont investi des milliards dans l’entraînement de modèles se concentrent maintenant sur l’inférence en temps réel. Des centaines de millions d’utilisateurs attendent des réponses instantanées. Les organisations qui planifient des déploiements IA doivent anticiper une demande soutenue en ressources de calcul.

La question qui se pose

L’investissement massif en infrastructure IA est-il soutenable à long terme ? Ou assistons-nous à la formation d’une bulle technologique comparable à celle des télécoms en 2000 ? Les décideurs doivent arbitrer entre investissement précoce et prudence budgétaire.

Mistral lance Forge : une plateforme d’IA sur mesure pour l’entreprise

Les projets d’IA en entreprise échouent rarement par manque de technologie. Ils échouent parce que les modèles génériques ne comprennent pas le contexte métier. Des décennies de documents internes, de workflows et de savoirs institutionnels restent invisibles pour un modèle entraîné sur des données internet.

La startup française Mistral propose une réponse à ce problème fondamental. Elle a annoncé Mistral Forge lors de la conférence GTC. Cette plateforme permet aux entreprises de construire des modèles IA personnalisés, entraînés spécifiquement sur leurs données propriétaires.

Un positionnement stratégique assumé

La stratégie de Mistral est délibérée. Pendant que ses concurrents dominent le marché grand public, Mistral se concentre sur les clients entreprises. Le résultat est tangible : l’entreprise se dirige vers 1 milliard de dollars de revenus récurrents annuels cette année.

L’approche diffère significativement de la concurrence. Là où la plupart des acteurs proposent du fine-tuning ou de la génération augmentée par récupération (RAG), Forge permet un entraînement depuis zéro. Cela offre une meilleure prise en charge des données non anglophones ou hautement spécialisées, un contrôle accru sur le comportement du modèle, et une moindre dépendance aux fournisseurs tiers.

Des cas d’usage concrets et diversifiés

Les premiers adoptants illustrent la polyvalence de la plateforme : Ericsson, l’Agence spatiale européenne, le cabinet italien Reply, ou encore le néerlandais ASML, qui a mené le tour de financement Serie C à une valorisation de 11,7 milliards d’euros.

Quatre cas d’usage principaux émergent. Les gouvernements ont besoin de modèles adaptés à des langues et contextes culturels spécifiques. Les institutions financières exigent des solutions conformes à des réglementations strictes. Les industriels recherchent des capacités de personnalisation étendues. Les entreprises technologiques veulent des modèles ajustés à leurs bases de code.

Ce que cela implique pour l’enseignement supérieur

Pour les établissements d’enseignement supérieur, l’enjeu est double. D’une part, la souveraineté des données devient un critère de choix technologique. D’autre part, la capacité à entraîner des modèles sur des corpus scientifiques ou pédagogiques spécialisés ouvre des perspectives inédites. La question n’est plus « faut-il adopter l’IA ? » mais « quel degré de personnalisation exiger ? ».

Google invente le « vibe design » avec Stitch

Après le « vibe coding », voici le « vibe design ». Google lance Stitch en version bêta. L’outil permet de créer des interfaces logicielles à partir de descriptions en langage naturel. Pas besoin d’être designer. Pas besoin de wireframes préalables.

Stitch, entièrement repensé, se présente comme un canevas infini piloté par l’IA. Il intègre un agent de design capable de raisonner sur l’ensemble de l’évolution d’un projet, un gestionnaire d’agents pour suivre la progression et exécuter des tâches en parallèle, et même des capacités vocales pour interagir directement avec le canevas.

Un outil d’augmentation, pas de remplacement

Le point essentiel : Stitch ne remplace pas les designers. Il accélère leur travail. C’est comparable au téléchargement d’un kit UI sur Figma ou au démarrage depuis un template personnalisé. Utile pour un premier jet. Indispensable quand le temps presse. Insuffisant pour un travail de différenciation créative exigeant.

Les utilisateurs peuvent intégrer leurs propres images, textes ou code. Ils peuvent assembler les écrans entre eux, visualiser le workflow complet, et même générer automatiquement les écrans logiques suivants.

Pourquoi les décideurs IA en entreprise doivent surveiller cette évolution

L’accessibilité de la conception d’interfaces à des non-spécialistes modifie profondément les dynamiques de création numérique. Pour les institutions, cela signifie des prototypages plus rapides, des coûts de développement initiaux réduits, et une démocratisation des compétences de design. Le risque ? Une standardisation esthétique si l’outil est utilisé sans discernement. Stitch est disponible gratuitement via Google Labs.

Une sénatrice américaine défie le Pentagone sur l’accès de xAI aux réseaux classifiés

La sénatrice Elizabeth Warren a interpellé le secrétaire à la Défense au sujet de la décision du Pentagone d’accorder à xAI, l’entreprise d’intelligence artificielle d’Elon Musk, l’accès à des réseaux militaires classifiés. Dans une lettre formelle, elle soulève des préoccupations graves sur les implications sécuritaires de ce partenariat.

Des comportements problématiques documentés

Au cœur de l’inquiétude : Grok, le chatbot de xAI. Celui-ci a produit des contenus troublants, incluant des conseils pour commettre des crimes violents, du matériel antisémite, et du contenu inapproprié impliquant des mineurs. Ces incidents questionnent la robustesse des garde-fous du système.

La sénatrice n’est pas isolée dans ses critiques. Plusieurs organisations à but non lucratif ont demandé la suspension immédiate du déploiement de Grok dans les agences fédérales. Une action collective en justice a été déposée contre xAI, alléguant la génération de contenu sexuel utilisant de vraies images de mineurs.

Un contexte de recomposition des partenariats IA militaires

L’affaire prend une dimension supplémentaire. Le Pentagone a récemment désigné Anthropic comme risque dans la chaîne d’approvisionnement, après que l’entreprise a refusé de fournir un accès militaire illimité à ses systèmes IA. Suite à ce différend, le département de la Défense s’est tourné vers de nouveaux partenariats avec OpenAI et xAI.

Un haut responsable du Pentagone confirme que Grok a été approuvé pour les environnements classifiés, sans avoir encore été déployé opérationnellement. La plateforme GenAI.mil, conçue pour fonctionner dans des environnements cloud gouvernementaux, doit accueillir l’outil prochainement.

Ce que cela révèle pour les décideurs IA en entreprise

Cette controverse dépasse le cadre militaire. Elle pose la question fondamentale de la gouvernance des systèmes IA en contexte sensible. Comment évaluer la fiabilité d’un fournisseur IA ? Quels garde-fous exiger avant tout déploiement en environnement critique ? Les établissements qui manipulent des données sensibles, qu’ils soient universitaires, hospitaliers ou de recherche, devraient observer attentivement cette situation.

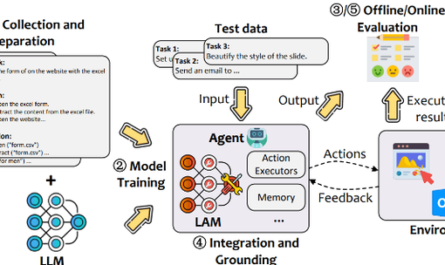

NVIDIA mise massivement sur les agents IA avec OpenClaw

Lors de la même conférence GTC, le PDG de NVIDIA a consacré une partie significative de son intervention à une technologie qui n’existait pas il y a quatre mois : les agents IA personnels d’OpenClaw.

NemoClaw, la contribution de NVIDIA à l’écosystème, intègre la famille de modèles open-source Nemotron dans les agents autonomes « auto-évolutifs » d’OpenClaw. Le système installe OpenClaw avec les modèles ouverts de NVIDIA, optimise les commandes via un toolkit dédié, et ajoute une couche de contrôle de confidentialité et de sécurité appelée OpenShell.

L’agent IA, tendance majeure de 2026

OpenClaw est devenu le projet ayant le plus d’étoiles sur GitHub. L’affirmation selon laquelle il s’agirait du « projet open-source le plus populaire de l’histoire de l’humanité » est excessive, des projets comme Linux ou Git constituant les fondations mêmes d’Internet. Mais la dynamique est indéniable.

Les agents représentent les systèmes IA les plus gourmands en tokens. NVIDIA construit donc l’infrastructure pour les alimenter. La plateforme Vera Rubin, une « usine à IA » composée de sept puces et cinq ordinateurs en rack, sera disponible au second semestre 2026. Elle intègre désormais le processeur Groq 3 LPU, conçu spécifiquement pour exécuter les modèles de langage à grande vitesse.

L’équation économique des agents

Les agents peuvent accomplir davantage. Ils peuvent aussi causer davantage de dégâts. Cela crée un marché croissant pour NVIDIA : rendre l’inférence moins chère, plus efficace, et résoudre les failles de sécurité.

Sur le terrain de l’inférence, NVIDIA possède un avantage moindre que sur l’entraînement. Des acteurs comme Cerebras captent des parts de marché en proposant une inférence plus rapide et moins coûteuse. L’acquisition de Groq pour 20 milliards de dollars vise précisément à combler cet écart.

Quatre tendances majeures issues de la GTC

Au-delà des annonces produits, quatre tendances structurantes ont émergé de la conférence. La robotique et l’IA physique progressent, avec des partenariats allant d’Uber à Figure. Les agents personnels s’imposent comme la tendance majeure de 2026. Les modèles ouverts se renforcent avec la Nemotron Coalition, réunissant Mistral, Perplexity, Cursor et d’autres. Enfin, l’impact de l’IA sur l’emploi devient un sujet central, les outils de codage n’étant que la première génération d’automatisation d’un mouvement bien plus vaste.

Mistral Small 4 : un modèle unique qui unifie raisonnement, vision et code

Mistral publie Mistral Small 4, premier modèle de l’entreprise à unifier les capacités de ses modèles phares. Magistral pour le raisonnement. Pixtral pour le multimodal. Devstral pour le codage agentique. Un seul modèle remplace trois. Sous licence Apache 2.0.

Les caractéristiques techniques clés

L’architecture repose sur un mélange d’experts (MoE) : 128 experts, dont 4 actifs par token. Le modèle totalise 119 milliards de paramètres, avec seulement 6 milliards actifs par token. La fenêtre de contexte atteint 256 000 tokens.

Les performances sont notables : 40 % de réduction du temps de complétion de bout en bout, et un débit trois fois supérieur à Mistral Small 3 en configuration optimisée. Le paramètre reasoning_effort permet de basculer entre réponses rapides et raisonnement profond selon le besoin.

L’efficacité comme avantage compétitif

Le véritable argument de Mistral Small 4 réside dans son efficacité par token. Sur les benchmarks, il égale ou surpasse des modèles concurrents tout en générant des réponses significativement plus courtes. Sur LiveCodeBench, il dépasse GPT-OSS 120B avec 20 % de texte en moins.

Pour les entreprises, cette efficacité impacte directement les coûts et la scalabilité. Des réponses plus courtes signifient une latence réduite, des coûts d’inférence diminués, et une meilleure expérience utilisateur. Pour les équipes techniques, cela simplifie le fine-tuning et l’intégration.

L’enjeu pour les déploiements IA en entreprise

Le modèle est entièrement open-source. Les cas d’usage sont larges : automatisation du code, assistants conversationnels, compréhension de documents, analyse multimodale, tâches de raisonnement complexes. Pour les organisations académiques et de recherche, la combinaison open-source, multimodalité et personnalisation constitue une proposition de valeur remarquable.

Leanstral : la preuve formelle entre dans l’ère de l’IA

Mistral franchit une frontière supplémentaire avec Leanstral, le premier agent de code open-source conçu pour Lean 4. Lean 4 est un assistant de preuves capable d’exprimer des objets mathématiques complexes et des spécifications logicielles. La promesse : des agents qui non seulement codent, mais prouvent formellement la validité de leur code.

Pourquoi c’est un tournant

Le goulot d’étranglement de l’IA dans le code à haut risque n’est pas la génération. C’est la vérification humaine. Le temps et l’expertise nécessaires pour valider manuellement deviennent le frein principal de la vélocité d’ingénierie.

Leanstral propose une alternative. Avec seulement 6 milliards de paramètres actifs et une architecture très efficiente, il offre des performances compétitives face à des modèles fermés bien plus coûteux. Les chiffres sont éloquents : à résultat comparable, Leanstral coûte 36 dollars contre 549 dollars pour un concurrent direct.

Les implications pratiques

Leanstral est disponible dans Mistral Vibe sans configuration, via une API gratuite ou quasi gratuite, et en téléchargement sous licence Apache 2.0. Les cas d’usage démontrés incluent la migration de code entre versions de Lean, la traduction de preuves formelles entre langages, et le raisonnement sur des programmes.

Pour les laboratoires de recherche et les départements d’informatique, l’arrivée d’un agent de preuve formelle open-source et abordable représente un levier d’accélération considérable. La vérification formelle, longtemps réservée aux spécialistes, devient accessible.

Manus lance « My Computer » : l’IA locale reprend le contrôle

À contre-courant de la tendance cloud, Manus propose une approche radicalement différente. Son nouveau dispositif « My Computer » installe des agents IA directement sur la machine de l’utilisateur, sous macOS et Windows.

L’agent accède aux fichiers locaux, exécute des commandes, et interagit avec les applications. Organisation de dossiers, édition de fichiers, exécution de scripts, assistance aux workflows de développement : tout se fait en local. L’utilisateur conserve le contrôle des approbations.

Le virage vers l’IA personnelle embarquée

En exploitant les ressources système de l’utilisateur, y compris le GPU, Manus peut traiter des tâches lourdes sans dépendre entièrement du cloud. C’est un changement de paradigme. L’IA personnelle migre du serveur distant vers le terminal.

Ce que cela signifie pour l’IA en entreprise

Pour les entreprises soucieuses de souveraineté des données et de confidentialité, le modèle de Manus mérite une attention particulière. Pas de données envoyées vers un serveur externe. Pas de dépendance à une connexion internet pour les tâches critiques. Le compromis ? Une puissance de calcul limitée aux capacités de la machine locale. Mais pour de nombreux cas d’usage quotidiens, c’est amplement suffisant.