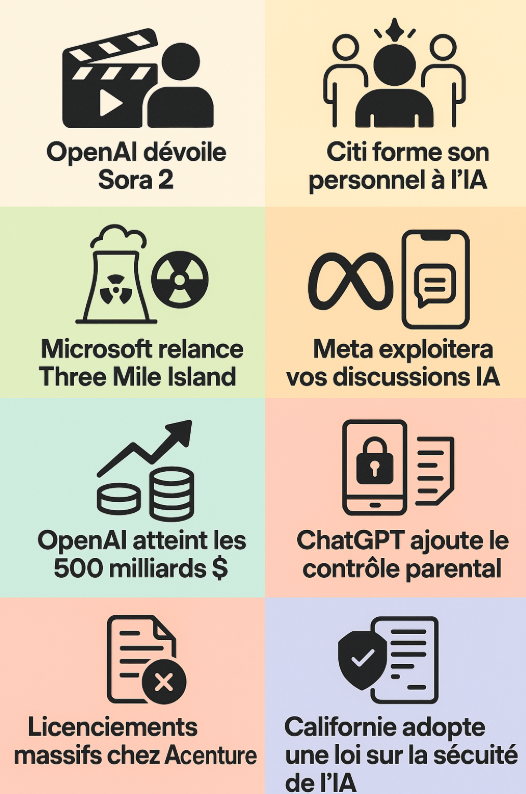

1. Sora 2 : l’IA vidéo pousse la frontière entre fiction et réalité

OpenAI annonce Sora 2, version améliorée de sa technologie de génération vidéo/audio, avec des rendus plus réalistes (physique, mouvements, synchronisation sonore) et une plus grande « steerability » (capacité à suivre précisément les orientations du prompt). L’application mobile Sora (iOS, phase pilote États-Unis/Canada) permet désormais la fonction «Cameo» : l’utilisateur peut s’intégrer dans le contenu généré, à condition de donner son consentement (et sous contraintes strictes). Chaque vidéo générée porte un filigrane et des métadonnées C2PA pour identifier son origine IA.

Mais, comme souvent, la révolution traîne ses ombres. Dès les premiers partages, des vidéos violentes, racistes ou manipulatrices ont émergé, remettant en cause la robustesse des garde-fous. La question du droit d’auteur est aussi aiguë : OpenAI impose un modèle d’« opt-out » — les ayants droit doivent expressément déclarer qu’ils refusent l’usage de leurs personnages ou contenus — ce qui pourrait redéfinir les rapports entre création, propriété intellectuelle et usage IA.

👉 Pour les décideurs :

- En entreprise, cela ouvre un océan d’opportunités pour la communication, la publicité et l’éducation interne. Un service marketing peut produire en heures ce qui demandait des semaines. Mais la contrepartie est un risque réputationnel majeur : une fausse vidéo d’un dirigeant ou d’une marque peut détruire la confiance instantanément.

- Pour les pouvoirs publics, la priorité est d’encadrer les usages : droit à l’image, responsabilité juridique, et dispositifs anti-désinformation. Car dans une campagne électorale ou face à des contenus haineux, la frontière vrai/faux devient une menace systémique.

2. Citi : 175 000 employés transformés en prompt engineers

La banque Citi impose une formation obligatoire aux prompts avancés pour ses 175 000 collaborateurs répartis dans 80 pays, les dotant d’un vocabulaire opérationnel pour exploiter les outils IA internes. Le programme s’intitule « Asking Smart Questions – Prompting like a Pro » ; les employés auront 60 jours pour terminer le cursus, avec adaptativité selon leur niveau initial (10 à 30 minutes selon les profils).

Citi a déjà traité 6,5 millions de prompts cette année, un volume révélateur de l’ampleur de l’intégration IA dans ses processus. L’objectif : passer du simple « usage opportuniste » à des workflows ultra-optimisés et mesurés par productivité IA plutôt que par temps passé.

👉 Pour les décideurs :

- Pour un dirigeant d’entreprise, l’enseignement est brutal : ignorer la montée en compétence IA, c’est condamner ses équipes à une productivité inférieure. Le recrutement et la mobilité interne se feront désormais sur la « littératie IA ».

- Pour un responsable public, l’affaire Citi illustre l’urgence d’intégrer ces savoir-faire dans la formation professionnelle nationale. Les pays qui ne généralisent pas les compétences IA creuseront un retard de compétitivité.

3. Microsoft relance la centrale nucléaire Three Mile Island pour alimenter l’IA

La demande énergétique de l’IA est telle que Microsoft a signé un accord de 20 ans pour relancer l’unité 1 de la centrale nucléaire de Three Mile Island (Pennsylvanie), afin de garantir une puissance continue, stable et massive pour ses infrastructures cloud et ses modèles IA. Le site pourrait fournir 835 mégawatts, soit l’équivalent de la consommation de plus de 700 000 foyers.

Ce n’est pas le seul pari énergétique de Microsoft : il investit aussi dans des start-ups nucléaires (fusion, réacteurs de nouvelle génération), tandis qu’Altman et Gates soutiennent des projets comme TerraPower ou Oklo.

👉 Pour les décideurs :

- Les dirigeants privés doivent prendre conscience que la course à l’IA est aussi une course énergétique. Sans accès garanti à une énergie fiable et massive, les projets IA risquent de s’arrêter net. Les partenariats stratégiques avec fournisseurs d’énergie deviennent vitaux.

- Les décideurs publics, eux, voient s’ouvrir une nouvelle bataille de souveraineté : comment alimenter une économie numérique gourmande sans dépendre d’acteurs étrangers ni sacrifier les engagements climatiques ? Le nucléaire redevient une option incontournable.

4. Meta exploite vos conversations IA pour affiner ses publicités

Meta a annoncé qu’elle commencera à exploiter nos interactions avec ses bots IA (Meta AI, etc.) pour personnaliser ses publicités et recommandations de contenu. Cette collecte ne concernera pas les sujets sensibles (religion, orientation sexuelle, santé, politique) dans certains territoires (notamment l’Union européenne). Mais pour les utilisateurs hors UE, UK et Corée (protégés par leur régulation) cette « nouvelle donnée de signal » sera intégrée sans possibilité de retrait. Avec 1 milliard d’usagers mensuels, Meta transforme l’intimité conversationnelle en ressource économique.

Pour Meta, c’est une extension logique de son modèle : chaque interaction (texte, image, audio) devient un levier de monétisation.

👉 Pour les décideurs :

- Côté entreprises, cela montre qu’un nouveau gisement de données se monétise : l’interaction elle-même. Les directions marketing doivent réfléchir à leur propre éthique dans l’usage de ces traces conversationnelles.

- Côté régulateurs, cette initiative est un signal d’alarme : la captation de données par défaut est redevenue la norme, et seule une législation ferme protège réellement les citoyens. Le RGPD apparaît ici comme un avantage stratégique.

5. OpenAI : valorisée 500 milliards de dollars, la pression monte

OpenAI a autorisé une vente secondaire d’actions pour ses employés, valorisant l’entreprise à 500 milliards USD – désormais la plus grande entité privée au monde selon cet indicateur. Ce mouvement n’est pas tant une quête de liquidité qu’un positionnement : l’entreprise s’« IPO-ise » déjà structurellement. L’entreprise dépasse SpaceX et devient la plus grande société privée mondiale.

Mais cette valorisation extrême impose des contraintes : gouvernance renforcée, transparence, attentes de rentabilité publique, responsabilité accrue devant les marchés.

👉 Pour les décideurs :

- Pour un dirigeant d’entreprise, cette valorisation prouve que l’IA concentre des flux financiers massifs. L’absence d’une stratégie IA claire expose désormais à un déclassement sectoriel.

- Pour un décideur public, OpenAI est un signal d’alerte : quand une seule entreprise concentre autant de valeur et de pouvoir, la question devient systémique. Quelle fiscalité ? Quelle régulation ? Quelle indépendance technologique pour les autres nations ?

6. ChatGPT renforce le contrôle parental

OpenAI propose maintenant des contrôles parentaux pour ChatGPT, afin de permettre aux parents (et aux adolescentes ou adolescents) de lier leurs comptes, restreindre certaines fonctionnalités (image, mode voix, mémoires, etc.), fixer des plages horaires, ou exclure des contenus jugés extrêmes (violence, sexualité, défis viraux). En cas de signalement automatique (par exemple, contenu montrant un danger imminent), les parents peuvent être alertés, voire les services d’urgence contactés selon le paramétrage.

Cette mesure survient après une polémique liée à la responsabilité morale de ChatGPT dans des cas de détresse auto-agressive, où des parents avaient porté plainte.

👉 Pour les décideurs :

- Pour une entreprise B2C, cela fixe un nouveau standard. Les produits IA adressés au grand public devront intégrer la « safety by design ». Ne pas le faire, c’est s’exposer à procès et scandales.

- Pour les décideurs publics, cela démontre qu’il faut rendre ces contrôles obligatoires. La régulation doit protéger les mineurs face aux IA conversationnelles, comme elle le fait pour les réseaux sociaux.

7. Californie adopte la loi SB-53 : transparence et responsabilité imposées

La Californie devient le premier État américain à imposer une obligation de transparence et de signalement pour les grands acteurs de l’IA (OpenAI, Anthropic, Google DeepMind, Meta…) via la loi SB-53 signée par le gouverneur Gavin Newsom. Les firmes devront publier leurs protocoles de sécurité, signaler les incidents de comportement autonome non supervisé, et protéger les lanceurs d’alerte internes.

TechCrunch note que cette législation est une démonstration que régulation et innovation ne sont pas forcément incompatibles.

👉 Pour les décideurs :

- Pour un dirigeant, la conclusion est simple : préparez dès aujourd’hui vos reportings sécurité IA. Cela deviendra une exigence mondiale, comme les normes environnementales ou comptables.

- Pour un décideur public, SB-53 est une inspiration. Elle prouve qu’encadrer l’IA est possible sans tuer l’innovation. L’Europe pourrait suivre avec un modèle similaire, consolidant sa position de régulateur mondial.

8. Accenture licencie 11 000 collaborateurs pour incompatibilité IA

Accenture a annoncé plus de 11 000 suppressions de poste dans le monde, ciblant les profils jugés « non requalifiables » pour l’ère IA, dans le cadre d’un plan de restructuration de 865 millions USD. L’effectif global est passé de 791 000 à 779 000 en quelques mois. La société revendique toutefois avoir déjà formé plus de 550 000 employés aux fondamentaux de la GenAI, mais précise qu’une condition (appétence technologique, rapidité d’apprentissage, compatibilité cognitive) sert désormais de filtre de sélection.

👉 Pour les décideurs :

- Pour une direction générale, c’est une rupture : l’« upskilling pour tous » n’est plus un dogme. Les entreprises devront assumer une sélection forte dans la reconversion, et gérer le choc social qui en découle.

- Pour les responsables publics, c’est une alerte sociale. La transition IA ressemble déjà à une désindustrialisation cognitive : certains métiers disparaîtront sans issue. La question est politique : créer un filet de sécurité pour les exclus de l’IA ou subir une fracture sociale majeure.

Conclusion : l’IA n’est plus une option à ce stade

La semaine 40 montre que l’IA touche désormais tous les piliers : création de contenus, formation des talents, énergie, régulation, emploi.

- Pour l’entreprise, l’enjeu n’est plus d’expérimenter, mais d’intégrer massivement, avec une gouvernance claire et une anticipation des risques. Voir mon poste sur l’impact de l’IA sur l’emploi : une recomposition silencieuse.

- Pour le décideur public, il ne s’agit plus de débattre en comité d’éthique, mais de légiférer, d’investir et de protéger, faute de quoi les équilibres économiques et sociaux basculeront.