Je vous livre ici une présentation de la keynote de Didier Paquelin au cours du bootcamp IA de l’Université Laval. J’ai trouvé cette présentation très riche et assez intéressante pour penser le cadre de l’usage des IA dans le domaine de l’éducation (et au-delà). C’est une présentation tout en nuance comme, personnellement, je les apprécie. La question posée principale étant : avec quel objectif utiliser l’IA ?

Contexte : sortir du débat caricatural

L’intelligence artificielle en éducation suscite deux réactions opposées. Enthousiasme technophile. Rejet moral. Entre les deux, peu de nuance. La keynote de Didier Paquelin propose précisément cela : de la nuance. Il ne s’agit ni de célébrer la machine, ni de la diaboliser. Il s’agit d’apprendre à la manier.

L’image choisie est forte : devenir des « maîtres fugu ». Ce poisson japonais, délicieux mais potentiellement mortel, exige expertise et discernement. L’IA relève du même régime. Pharmakon : remède et poison. Tout dépend de l’usage.

La question n’est donc pas : « Faut-il utiliser l’IA ? »

La vraie question est : « Dans quelle intention l’utilisons-nous ? »

Une tension structurelle : performance contre apprentissage

Didier Paquelin replace l’IA dans un contexte sociétal plus large : celui de l’accélération permanente. Performance, instantanéité, optimisation.

Or l’éducation ne relève pas de la même temporalité.

- La machine calcule en millisecondes.

- L’apprentissage transforme des structures cognitives.

- Le temps de l’apprentissage n’est pas le temps de la machine.

L’enjeu stratégique pour les établissements est clair : ne pas laisser la logique d’efficacité dicter la logique pédagogique.

Aller plus vite n’est pas apprendre mieux. Automatiser n’est pas comprendre. Produire n’est pas transformer.

Dans plusieurs de ses travaux sur l’expérience étudiante et l’engagement, Paquelin insiste d’ailleurs sur la dimension processuelle de l’apprentissage : apprendre, c’est modifier des processus internes, mobiliser des fonctions cognitives, construire du sens. Ce n’est pas livrer une performance ponctuelle.

Deux polarités d’usage : efficacité et approfondissement

L’IA ouvre deux grandes familles d’usage.

1. La main gauche : l’efficacité

- Résumer un article

- Traduire un texte

- Géner un plan

- Automatiser une tâche répétitive

Ici, l’IA est prothèse. Elle fait à notre place. Elle réduit la charge cognitive extrinsèque. Elle libère du temps.

C’est utile. Et souvent nécessaire.

2. La main droite : l’approfondissement

- Explorer des points de vue contradictoires

- Tester des hypothèses

- Simuler un débat

- Questionner un raisonnement

Ici, l’IA devient partenaire intellectuel. Elle stimule. Elle confronte. Elle élargit.

La formule centrale de la keynote mérite d’être méditée : « La main gauche ne doit pas ignorer ce que fait la main droite. »

Autrement dit : le temps gagné par l’automatisation doit être réinvesti dans l’approfondissement. Sinon, nous remplaçons simplement l’effort par la vitesse. Et nous perdons en profondeur.

Quatre figures d’usage : de la prothèse à la co-création

Didier Paquelin propose une typologie précieuse pour les décideurs :

- Prothèse / Assistance

L’IA agit à la place de l’utilisateur. Traduction, rédaction simple, synthèse. - Orthèse / Soutien

L’IA aide à mieux faire. Elle soutient l’action sans s’y substituer totalement. - Dialogue augmenté

L’IA devient interlocuteur. Elle questionne, reformule, propose des angles. - Co-création

L’humain et l’IA produisent ensemble. Une hybridation cognitive émerge.

Cette gradation n’est pas anodine. Elle dessine une trajectoire pédagogique.

Plus on monte, plus l’agentivité humaine doit être forte. Moins on pense, plus la machine pense pour nous. Plus on questionne, plus la machine devient levier d’intelligence.

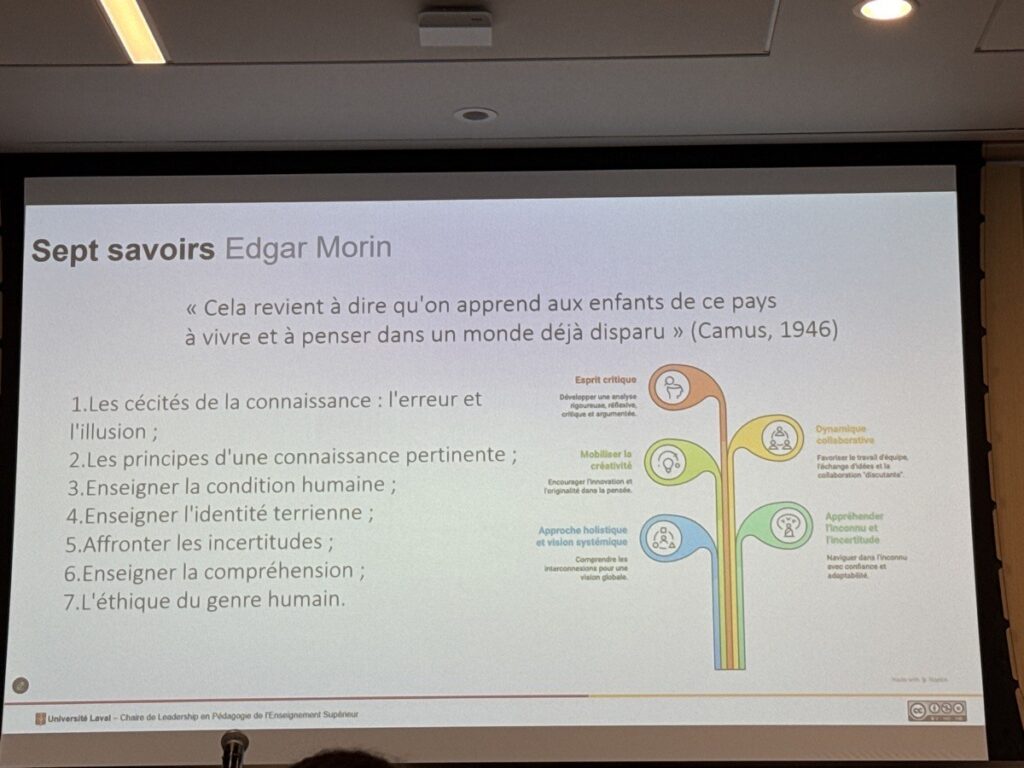

Le cœur du sujet : l’esprit critique comme compétence stratégique

S’il ne fallait retenir qu’une seule priorité pédagogique, Paquelin est sans ambiguïté : l’esprit critique. Non pas au sens superficiel du scepticisme. Mais au sens exigeant du questionnement structuré.

- Quels sont les biais possibles ?

- Quelles hypothèses implicites structurent la réponse ?

- Quels points de vue sont absents ?

- Quelle est la source du raisonnement ?

Dans un environnement saturé de production automatisée, la compétence rare n’est plus de produire du texte. C’est d’évaluer, d’interroger, de contextualiser.

Pour les établissements d’enseignement supérieur, l’enjeu est stratégique : former des étudiants capables d’interagir avec des systèmes intelligents sans leur déléguer leur jugement.

Sinon, nous formerons des opérateurs de prompts. Pas des penseurs.

Réhabiliter la dimension eudémonique de l’effort

Une idée forte traverse la keynote : la satisfaction de l’effort accompli. L’IA réduit la friction. L’apprentissage nécessite de la friction.

Il ne s’agit pas de glorifier la difficulté inutile. Mais de rappeler que l’effort cognitif produit une forme de joie durable : celle d’avoir compris. Si tout devient instantané, que reste-t-il de cette expérience ?

Pour les décideurs académiques, cela implique de repenser les dispositifs d’évaluation, les scénarios pédagogiques et les critères de réussite. La facilité technologique ne doit pas dissoudre l’exigence intellectuelle.

Trois principes d’action pour les établissements

- L’intention avant l’outil

Chaque usage de l’IA doit être précédé d’une question stratégique : efficacité ou approfondissement ? Substitution ou développement ? - Institutionnaliser le questionnement

Former explicitement à l’analyse critique des réponses générées. Intégrer des phases de validation, de confrontation, de débat. - Favoriser l’agentivité conjointe

Concevoir des activités où l’IA nourrit la collaboration humaine au lieu de l’isoler : débats à partir de réponses générées, scénarios complexes co-analysés, projets hybrides.

Conclusion : gouverner l’IA plutôt que la subir

La keynote de Didier Paquelin ne propose pas une liste d’outils. Elle propose une posture.

Ne pas céder à l’emballement. Ne pas s’abriter derrière la peur. Construire une maturité collective.

L’IA en éducation n’est pas un problème technique. C’est une question anthropologique et pédagogique. Elle interroge notre conception de l’apprentissage, du temps, de l’effort et de l’intelligence.

Devenir des « maîtres fugu » n’est pas une métaphore décorative. C’est une exigence stratégique.

FAQ – IA en éducation et stratégie académique

Pourquoi parler d’IA comme pharmakon en éducation ?

Parce que son impact dépend de l’usage. Elle peut renforcer l’apprentissage ou favoriser la superficialité.

Quelle compétence prioritaire développer face à l’IA ?

L’esprit critique, structuré par l’art du questionnement.

L’IA menace-t-elle l’apprentissage profond ?

Oui, si elle est utilisée uniquement pour accélérer la production sans réinvestir le temps gagné dans l’analyse et la réflexion.

Comment intégrer l’IA dans l’enseignement supérieur ?

Par une stratégie institutionnelle claire : intentionnalité des usages, formation au discernement, scénarios pédagogiques hybrides.