Comment je fais fonctionner un Deepseek-R1 en local sur mon ordinateur avec LM Studio ?

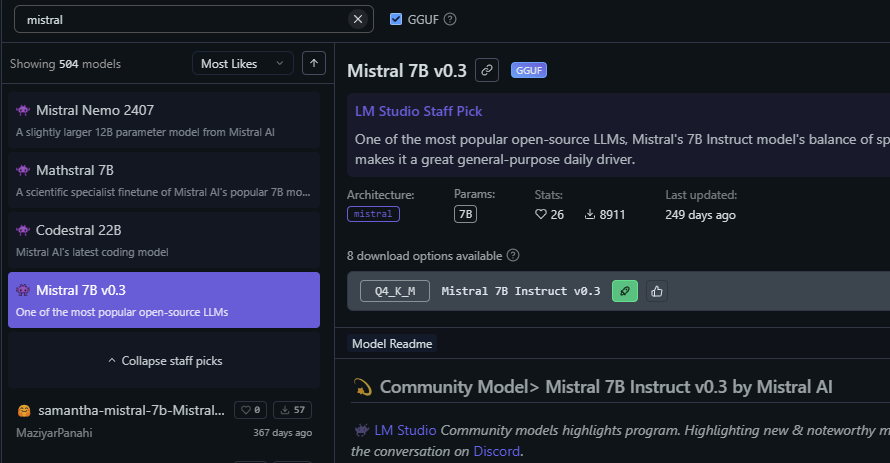

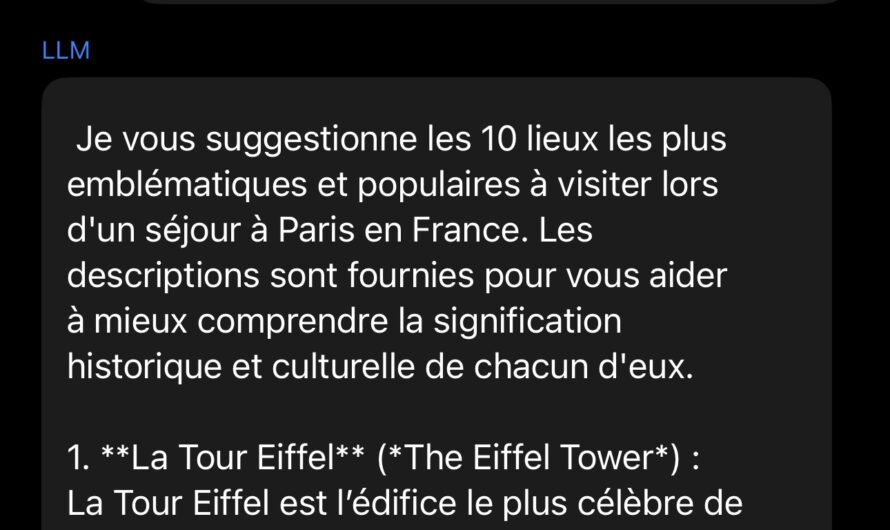

LM Studio est une application conviviale qui permet d’exécuter des modèles de langage (LLM) directement sur votre ordinateur, sans dépendre des services cloud. Elle est compatible Windows, MacOS et Linux et peut se trouver facilement à l’adresse officielle : https://lmstudio.ai/. Elle permet même de faire fonctionner en local des versions de Deepseek-R1… c’est encore qu’un début, mais déjà une belle prouesse !